【米国株】知識蒸留の基本的な仕組みとは!?サイバー攻撃はどこから…?

中国の人工知能(AI)スタートアップ企業ディープシークが世界を驚かせた最新のAIモデルは、米オープンAIのコンテンツを学習させる手法を用いて開発された。第2次トランプ政権でAIの政策責任者を務めるデービッド・サックス氏が指摘した。

サックス氏は28日、FOXニュースに出演し、ディープシークは「知識蒸留」と呼ばれる手法を採用していると説明した。新しいAIモデルが既存モデルに何百万もの質問を繰り返すことで、既存モデルの知識を学び、推論プロセスを模倣する開発手法だ。

シリコンバレーの著名ベンチャーキャピタリストとして知られるサックス氏は、「ディープシークがオープンAIのモデルから知識を蒸留したという確固たる証拠がある」と指摘。「オープンAIがこれを喜んでいるとは思えない」と話した。

5: 山師さん 2023/03/22(水) 21:00:42.55 ID:y6L3fjON0 (´・ω・`)お前らプレの時間だよ! 8: 山師さん 2023/03/22(水) 21:01:16.34 ID:s/lY2XNQa >>5 銀行に投棄してんの? 12: 山師さん 2023/03/22(水) 21:02:45.95 ID:y6L3fjON0 >>8 ( […]

202: 山師さん 2022/02/27(日) 19:45:11.61 ID:2p0w/guJ0 インデックスファンド引き上げる話すると、30年後は絶対に上がってるという人が出てくるけど 30年後に確信があるなら、その過程として10年後も5年後も見えてるはずなんだよな 一番近くでどこまでの将来が見据えられてるのか教えてほしいわ 221: 山師さん 2022/02/27(日) 19:49:06.36 […]

549: 山師さん 2022/09/20(火) 20:40:06.20 ID:71b9V4RPM なんでipqhone14出たのにsoxl爆上げしてくれないの、、、 553: 山師さん 2022/09/20(火) 20:41:03.16 ID:PbLsE2mt0 >>549 毎年恒例やし 575: 山師さん 2022/09/20(火) 20:46:50.97 […]

17: 山師さん 2022/12/17(土) 09:17:09.38 ID:M29et48qd  イーロン・マスク *ツイッター社の売却模索 *買収時と同値(1株$54.20)にて Musk Is Seeking New Twitter Investors at Same Price He Paid – BBG こいつ何がしたいん?ストーカー凍結したか […]

イーロン・マスク *ツイッター社の売却模索 *買収時と同値(1株$54.20)にて Musk Is Seeking New Twitter Investors at Same Price He Paid – BBG こいつ何がしたいん?ストーカー凍結したか […]

612: 山師さん 2023/05/27(土) 00:09:42.15 ID:b8HP8yJx0 データセンター向けGPUは将来、学習は NVDA、推論はAMDって棲み分けになる気がしてきた。 NVDA売ってAMD買おうかな 621: 山師さん 2023/05/27(土) 00:11:17.34 ID:pg9UbyEba >>612 わざわざ分ける意味ある? 同じ拠点で使うなら学習に使 […]

>>728

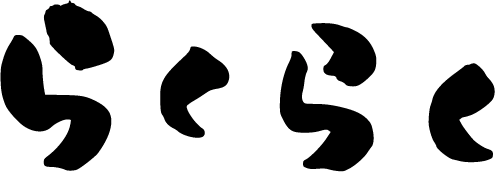

「知識蒸留(Knowledge Distillation)」は、機械学習におけるモデル圧縮技術の一種であり、大規模なAIモデル(教師モデル)から小型のAIモデル(生徒モデル)へ知識を効率的に移転する手法のこと。

基本的な仕組み

1. 教師モデルの出力を利用

既存の大規模モデル(例:GPT-4)が大量のデータを学習済みであるとする。

このモデルに対して膨大な質問を投げかけ、その出力(回答)を収集する。

2. 生徒モデルの学習

小型のモデル(例:GPT-3相当)が、教師モデルの出力を模倣するように学習。

通常の教師あり学習では「正解ラベル(例:猫の画像 → ‘猫’)」を使うが、知識蒸留では「教師モデルの予測(例:‘猫:95%、犬:5%’)」を活用する。

3. 温度パラメータの調整

知識蒸留では、出力の確率分布を調整する「温度(Temperature)」パラメータが使われる。

高温(Soft Target)だと確率分布が滑らかになり、微妙な違いも学習可能。

4. 生徒モデルの性能向上

小型モデルが、教師モデルの高度な推論やパターン認識を学習し、元のデータセットを使わなくても高精度のAIが得られる。

利点

計算コストの削減:小型モデルなので、推論時のリソース消費が少ない。

高速な処理:モバイル端末や組み込みシステム向けに最適化できる。

知識の圧縮:大規模モデルの持つ情報をコンパクトにまとめられる。

問題点

知的財産権の問題:第三者のAIモデルから知識を「蒸留」する場合、それが許可されたものでなければ倫理的・法的に問題になる可能性がある。

品質の劣化:生徒モデルは教師モデルの単純化版であり、完全に同じ性能を発揮できるとは限らない。

今回のケースとの関係

「ディープシーク」が「オープンAIのモデルから知識を蒸留した」とされているが、これは「知識蒸留」の技術を使ってGPT-4などのモデルに大量の質問をし、その回答データを使って独自のモデルを学習させた可能性を示唆している。もしこれがオープンAIの利用規約違反や知的財産権の侵害に当たるなら、倫理・法的な問題になりうる。

なるほどねぇ

まさに天才的発想だけど、教師モデルがないと成り立たないんだな

AAPL「これや

OpenAIはo3のオリジナルは公開しないで自社で蒸留済みのo3だけ公開すればいいんじゃね?

ちゃんと読めば蒸留が防ぎにくいのがわかる

それはまあそうだろうなって

これもう完全に戦争だろ

仲良くしてほしい

よほど都合が悪いようだなm9

米国のIPアドレスに偽装した中国国内からの攻撃の線もあるよな

中国人だってNVDA株大好きだろ

中国内も競争激しいからねえ

草

もう世界が動いてしまってるからどうなるやら

その時に買うよ

引用元: https://ift.tt/MzwRmQc